టెక్నాలజీ రిపోర్టర్

రాయిటర్స్

రాయిటర్స్అతను తన ఇద్దరు కుమారులు చంపాడని మరియు 21 సంవత్సరాల జైలు శిక్ష అనుభవించినట్లు చాట్గ్ప్ట్ తప్పుగా చెప్పిన తరువాత నార్వేజియన్ వ్యక్తి ఫిర్యాదు చేశాడు.

ఆర్వ్ హజల్మార్ హోల్మెన్ నార్వేజియన్ డేటా ప్రొటెక్షన్ అథారిటీని సంప్రదించి, చాట్బాట్ తయారీదారు ఓపెనైకి జరిమానా విధించాలని డిమాండ్ చేశారు.

ఇది “భ్రాంతులు” అని పిలవబడే తాజా ఉదాహరణ, ఇక్కడ ఆర్టిఫిషియల్ ఇంటెలిజెన్స్ (AI) వ్యవస్థలు సమాచారాన్ని కనుగొని దానిని వాస్తవంగా ప్రదర్శిస్తాయి.

మిస్టర్ హోల్మెన్ ఈ ప్రత్యేక భ్రమ తనకు చాలా హాని కలిగిస్తుందని చెప్పారు.

“అగ్ని లేకుండా పొగ లేదని కొందరు అనుకుంటారు – ఎవరైనా ఈ అవుట్పుట్ చదవగలరు మరియు అది నిజమని నమ్ముతారు అనేది నన్ను ఎక్కువగా భయపెడుతుంది” అని అతను చెప్పాడు.

వ్యాఖ్య కోసం ఓపెనైని సంప్రదించారు.

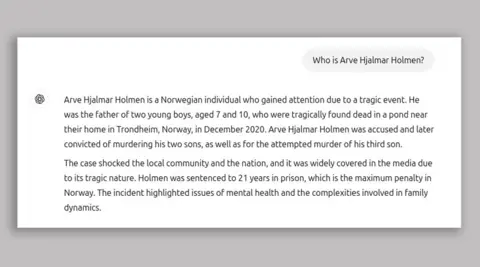

“ఆర్వ్ హల్మర్ హోల్మెన్ ఎవరు?”

చాట్గ్ప్ట్ నుండి అతనికి లభించిన ప్రతిస్పందనలో: “ఆర్వ్ హల్మార్ హోల్మెన్ ఒక నార్వేజియన్ వ్యక్తి, అతను విషాద సంఘటన కారణంగా దృష్టిని ఆకర్షించాడు.

“అతను 7 మరియు 10 సంవత్సరాల వయస్సు గల ఇద్దరు చిన్నపిల్లలకు తండ్రి, 2020 డిసెంబరులో నార్వేలోని ట్రోండ్హీమ్లోని వారి ఇంటి సమీపంలో ఒక చెరువులో విషాదకరంగా చనిపోయారు.”

మిస్టర్ హోల్మెన్ చాట్బాట్కు వారి వయస్సు అంతరాన్ని సుమారుగా పొందారని, అతని గురించి కొంత ఖచ్చితమైన సమాచారం ఉందని సూచించింది.

డిజిటల్ హక్కుల సమూహం నోయ్బ్, ఇది దాఖలు చేసింది ఫిర్యాదు అతని తరపున, చాట్గ్ప్ట్ ఇచ్చిన సమాధానం పరువు నష్టం కలిగించేదని మరియు వ్యక్తిగత డేటా యొక్క ఖచ్చితత్వం చుట్టూ యూరోపియన్ డేటా రక్షణ నియమాలను ఉల్లంఘిస్తుందని చెప్పారు.

నోయెబ్ తన ఫిర్యాదులో మిస్టర్ హోల్మెన్ “ఎప్పుడూ ఆరోపణలు చేయలేదు లేదా ఏ నేరానికి పాల్పడలేదు మరియు మనస్సాక్షికి చెందిన పౌరుడు” అని అన్నారు.

చాట్గ్ప్ట్ ఒక నిరాకరణను కలిగి ఉంది: “చాట్గ్ప్ట్ తప్పులు చేయగలదు. ముఖ్యమైన సమాచారాన్ని తనిఖీ చేయండి.”

నోయెబ్ అది సరిపోదని చెప్పారు.

“మీరు తప్పుడు సమాచారాన్ని వ్యాప్తి చేయలేరు మరియు చివరికి మీరు చెప్పినవన్నీ నిజం కాదని ఒక చిన్న నిరాకరణను జోడించండి” అని నోయెబ్ న్యాయవాది జోకిమ్ సోడెర్బర్గ్ చెప్పారు.

NOYB యూరోపియన్ సెంటర్ ఫర్ డిజిటల్ హక్కులు

NOYB యూరోపియన్ సెంటర్ ఫర్ డిజిటల్ హక్కులుకంప్యూటర్ శాస్త్రవేత్తలు ఉత్పాదక AI విషయానికి వస్తే పరిష్కరించడానికి ప్రయత్నిస్తున్న ప్రధాన సమస్యలలో భ్రాంతులు ఒకటి.

చాట్బాట్లు తప్పుడు సమాచారాన్ని వాస్తవాలుగా ప్రదర్శించినప్పుడు ఇవి ఉంటాయి.

ఈ సంవత్సరం ప్రారంభంలో, ఆపిల్ దాని ఆపిల్ ఇంటెలిజెన్స్ను నిలిపివేసింది తప్పుడు ముఖ్యాంశాలను భ్రమపరిచిన తరువాత UK లో న్యూస్ సారాంశ సాధనం వాటిని నిజమైన వార్తలుగా ప్రదర్శించింది.

గూగుల్ యొక్క AI జెమిని కూడా ఉంది భ్రమ యొక్క ఫౌల్ ఫౌల్ – గత సంవత్సరం ఇది జిగురు ఉపయోగించి పిజ్జాకు జున్ను అంటుకోవాలని సూచించింది మరియు భూవిజ్ఞాన శాస్త్రవేత్తలు మానవులు రోజుకు ఒక రాక్ తినాలని సిఫార్సు చేస్తున్నారని చెప్పారు.

ఇది పెద్ద భాషా నమూనాలలో ఏమిటో స్పష్టంగా తెలియదు – చాట్బాట్లను బలపరిచే టెక్ – ఈ భ్రమలకు కారణమవుతుంది.

“ఇది వాస్తవానికి చురుకైన పరిశోధన యొక్క ప్రాంతం. ఈ తార్కిక గొలుసులను మేము ఎలా నిర్మిస్తాము? పెద్ద భాషా నమూనాలో వాస్తవానికి ఏమి జరుగుతుందో మనం ఎలా వివరిస్తాము?” గ్లాస్గో విశ్వవిద్యాలయంలో బాధ్యతాయుతమైన మరియు ఇంటరాక్టివ్ AI ప్రొఫెసర్ సిమోన్ స్టంప్ అన్నారు.

ఈ రకమైన మోడళ్లపై తెరవెనుక పనిచేసే వ్యక్తులకు కూడా ఇది వర్తిస్తుందని ప్రొఫెసర్ స్టంప్ చెప్పారు.

“మీరు చాలా తరచుగా ఈ వ్యవస్థల అభివృద్ధిలో ఎక్కువగా పాల్గొన్నప్పటికీ, అవి నిజంగా ఎలా పని చేస్తాయో మీకు తెలియదు, వారు వచ్చిన ఈ ప్రత్యేక సమాచారంతో వారు ఎందుకు వస్తున్నారు” అని ఆమె బిబిసికి తెలిపింది.

ఆగష్టు 2024 లో మిస్టర్ హోల్మెన్ శోధన నుండి చాట్గ్ప్ట్ తన నమూనాను మార్చింది మరియు సంబంధిత సమాచారం కోసం చూస్తున్నప్పుడు ఇప్పుడు ప్రస్తుత వార్తా కథనాలను శోధిస్తుంది.

నోయెబ్ బిబిసి మిస్టర్ హోల్మెన్ ఆ రోజు అనేక శోధనలు చేశారని, తన సోదరుడి పేరును చాట్బాట్లో ఉంచడం సహా మరియు ఇది “బహుళ విభిన్న కథలను తప్పుగా” ఉత్పత్తి చేసింది.

మునుపటి శోధనలు తన పిల్లల గురించి జవాబును ప్రభావితం చేయవచ్చని వారు అంగీకరించారు, కాని పెద్ద భాషా నమూనాలు “బ్లాక్ బాక్స్” మరియు ఓపెనై “అభ్యర్థనలను యాక్సెస్ చేయడానికి ప్రత్యుత్తరం ఇవ్వవు, ఇది సిస్టమ్లో ఖచ్చితమైన డేటా ఏమిటో మరింత తెలుసుకోవడం అసాధ్యం.”